Современные алгоритмы Google Ads обрабатывают миллионы сигналов в режиме реального времени. Но их растущая сложность создает новую проблему — барьеры прозрачности. Системы машинного обучения, которые должны повышать эффективность рекламы, могут непреднамеренно исключать целые демографические группы из важных возможностей.

В статье разберем механизмы работы алгоритмов Google, проанализируем доступные инструменты диагностики и практические метрики для выявления скрытой дискриминации в рекламных кампаниях.

Невидимая рука алгоритма

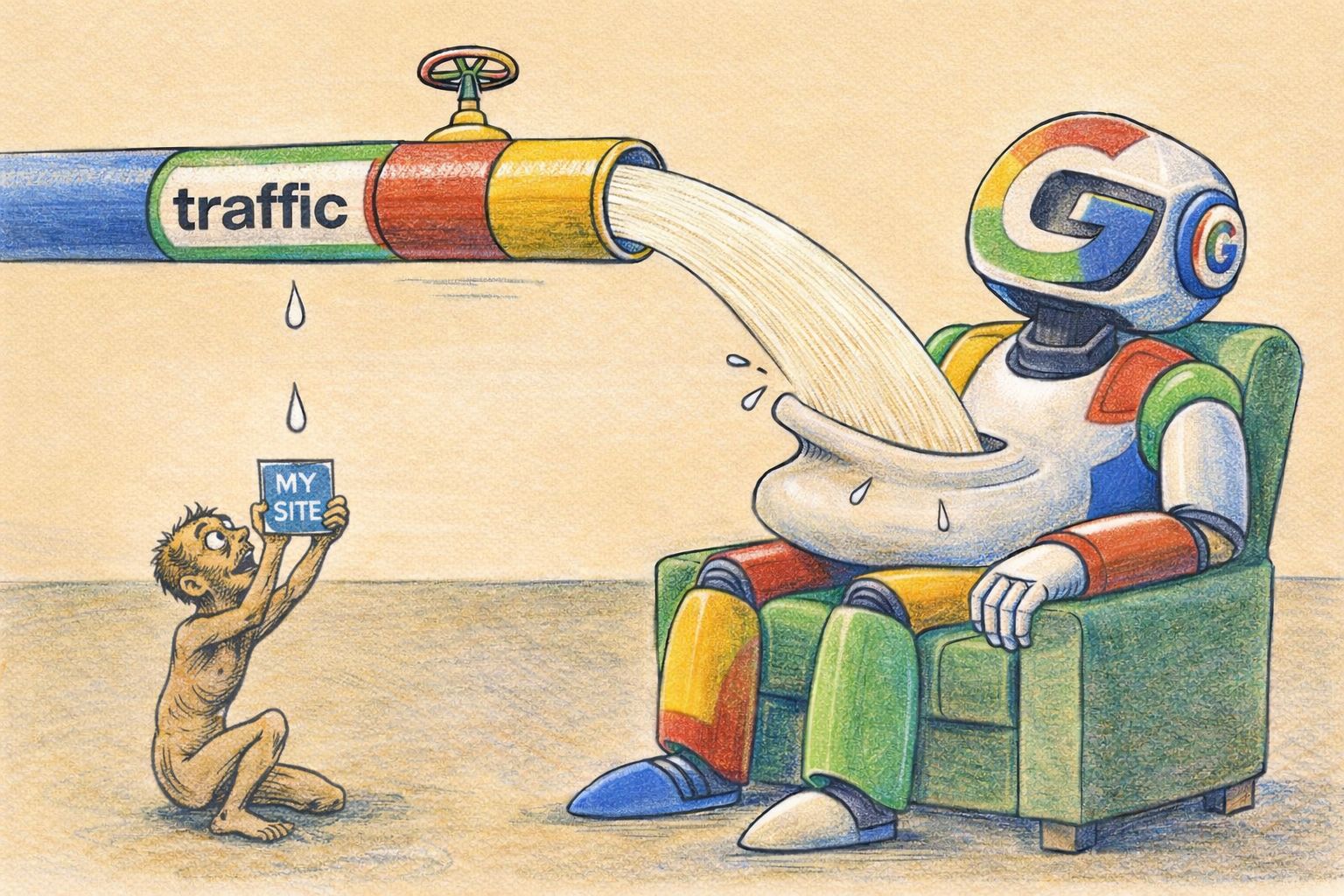

Google AdSense обслуживает более 2 миллионов партнерских сайтов. Алгоритмы принятия решений этой системы остаются непроницаемыми для рекламодателей. Машинное обучение классифицирует информацию на основе онлайн-прокси для чувствительных атрибутов. Это приводит к предвзятости против определенных групп, даже если решения напрямую не основаны на членстве в этих группах.

Онлайн-прокси — это факторы, используемые в процессе скоринга алгоритма, которые служат заменителями защищенных групп. Например, почтовый индекс может служить прокси для расы, а рост и вес — для пола. Подобные механизмы создают дискриминационные результаты даже при нейтральных настройках.

В 2024 году Google начал внедрение Topics API вместо сторонних cookies. Эта технология группирует пользователей по интересам без раскрытия индивидуальных данных. Однако она может создавать новые формы алгоритмической дискриминации через кластеризацию пользователей.

Что показывают новые исследования

В 2024 году проблема алгоритмической дискриминации получила новое подтверждение. Исследования показывают, что компании теряют доходы из-за предвзятых решений ИИ-систем. При скрининге резюме ИИ-инструменты демонстрируют серьезные гендерные перекосы.

Однако корни проблемы уходят глубже.Исследование Carnegie Mellon 2015 года с инструментом AdFisher остается актуальным. Эксперимент с 1000 виртуальными пользователями показал, что мужчины видели рекламу высокооплачиваемых вакансий около 1800 раз, женщины — всего 300 раз. Из 500 мужчин 402 получили такую рекламу хотя бы раз, но только 60 из 500 женщин столкнулись с аналогичными предложениями.

Google Analytics 4 как детектор предвзятости

Google Analytics 4 предоставляет демографические данные о возрасте, поле, местоположении, языке и интересах пользователей. Для получения полной картины требуется активация Google Signals. Эта система агрегирует данные пользователей, которые вошли в свои аккаунты Google и разрешили персонализацию рекламы.

Google применяет пороги данных для защиты приватности пользователей. Если сайт не получает достаточного трафика, GA4 может ограничить данные в отчетах. Основные причины отсутствия демографических данных включают неактивированные Google Signals, блокировку cookies пользователями и влияние законов о конфиденциальности.

Практические рекомендации по использованию GA4:

Регулярно проверяйте демографические отчеты на предмет неожиданных перекосов. Сравнивайте фактическую аудиторию с целевой для выявления систематических исключений. Используйте фильтры для анализа поведения разных демографических групп.

Изменения в алгоритмах Google 2024-2025

Google продолжает модернизацию своих алгоритмов машинного обучения. В 2024 году компания внедрила новые возможности для создания более справедливых рекламных кампаний. Обновленные ИИ-модели теперь настраиваются с использованием данных о производительности в различных отраслях.

Система Performance Max получила значительные обновления. Рекламодатели теперь могут устанавливать специфические цели для привлечения новых клиентов. Автоматизированные корректировки ставок основываются на пожизненной ценности клиента.

Новые функции включают автоматически создаваемые активы (ACA). Эта функция позволяет генерировать заголовки, описания и изображения для рекламы с помощью машинного обучения. Система изучает поведение пользователей и контекст рекламы для создания релевантного контента.

Метрики, которые имеют значение

Современные исследования выделяют несколько ключевых метрик для оценки справедливости алгоритмов. Disparate Impact Analysis измеряет, получает ли одна группа значительно худшие результаты по сравнению с другой. Применяется правило «четырех пятых»: если коэффициент отбора для любой группы составляет менее 80% от коэффициента для группы с наивысшим показателем, это может указывать на дискриминацию.

Fairness-aware Performance Metrics оценивают не только общую эффективность алгоритма, но и его справедливость по отношению к различным группам. Эти метрики включают равенство возможностей, демографический паритет и равенство шансов.

Важно анализировать не только равенство результатов, но и равенство частоты ошибок для разных групп. Алгоритм может точно предсказывать поведение всех пользователей, но систематически недооценивать интерес определенных демографических групп.

Практические решения для справедливой рекламы

Регулярный мониторинг и аудит систем ИИ критически важны для выявления и устранения возникающих предвзятостей. Google внес значительные изменения в политику таргетинга для чувствительных категорий. С 2020 года рекламодатели не могут таргетировать кредиты, жилье и рекламу вакансий на основе демографических данных. Запрет распространяется на возраст, пол, семейное положение и почтовый индекс.

Компании могут создавать контрольные группы с заведомо равномерным распределением по демографическим признакам. Это позволяет сравнивать результаты с автоматической оптимизацией.

Акт об ИИ ЕС, вступивший в силу в августе 2024 года, устанавливает новые требования для аудита предвзятости. Для высокорисковых ИИ-систем обязательны оценки влияния на основные права и аудиты предвзятости. Европейское бюро по ИИ получило полномочия проводить аудиты, расследовать нарушения и налагать штрафы до 30 миллионов евро или 6% от годового оборота компании.

Показательный пример системных нарушений произошел в Нидерландах. Правительство использовало алгоритм для предсказания мошенничества с детскими пособиями. Без каких-либо доказательств мошенничества налоговые органы заставили 26 000 родителей вернуть десятки тысяч евро. Система целенаправленно таргетировала лиц с двойным гражданством и этнические меньшинства, не предоставляя права на апелляцию. Голландское управление по защите данных признало методы налоговых органов дискриминационными.

Справедливость как конкурентное преимущество

Современный анализ демографических данных в Google Analytics 4 выявил критический факт: компании с программами тестирования предвзятости на 23% реже сталкиваются с финансовыми потерями. Это не просто этическое требование — это измеримое конкурентное преимущество. Ключевые шаги включают внедрение метрик справедливости в процесс оценки кампаний, регулярный аудит демографических данных и создание контрольных групп для тестирования алгоритмических решений.

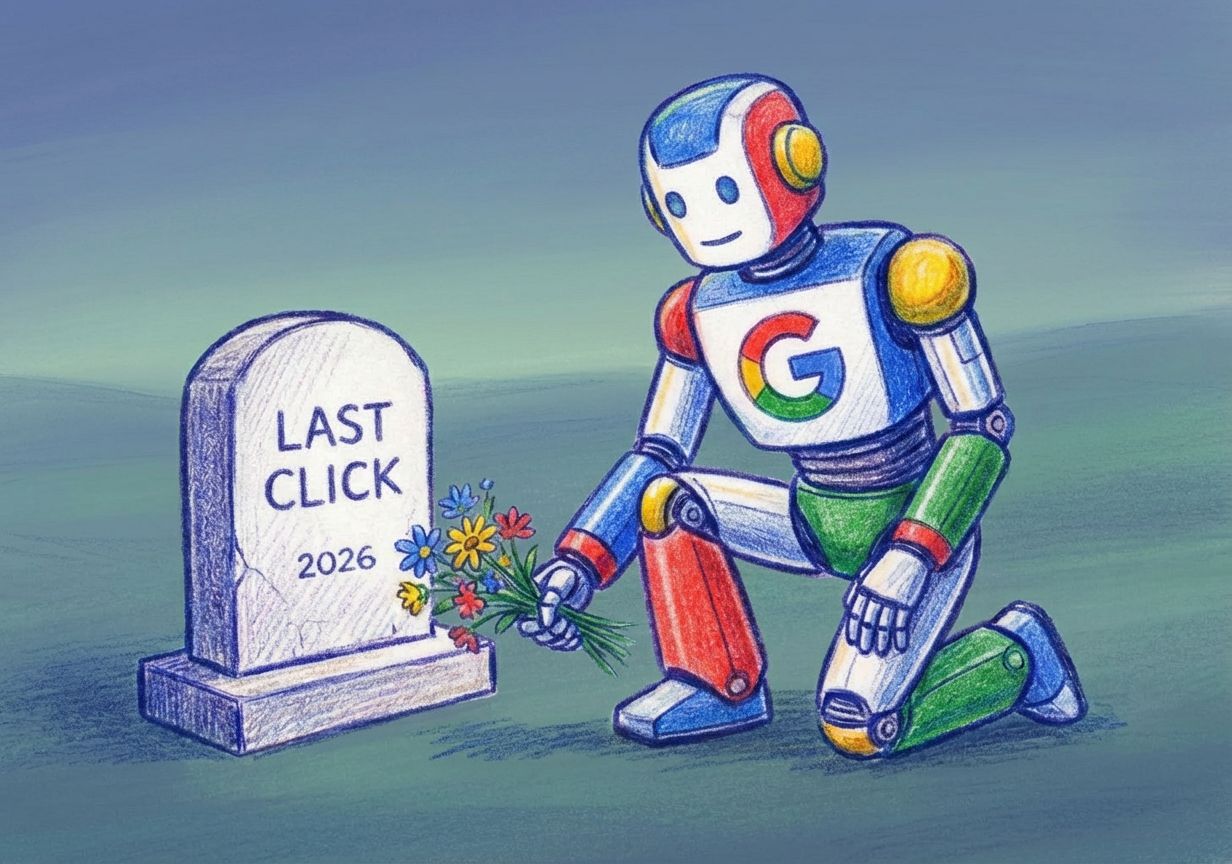

Индустрия стоит на пороге кардинальных изменений. IAB State of Data 2025 показывает, что половина рекламодателей планирует полную интеграцию ИИ к 2026 году, однако половина индустрии не имеет стратегического плана внедрения. Прогнозы экспертов MarTech указывают на развитие «Contextual 2.0» — новой волны контекстного таргетинга, основанного на технологиях, дружественных к приватности.

Технологические компании разрабатывают планы масштабной автоматизации рекламы. Руководители крупнейших платформ заявляют о намерениях существенно упростить процесс создания и управления кампаниями через ИИ-автоматизацию. Аналитики предупреждают о переоценке возможностей автоматизации — роль агентств трансформируется в сторону стратегического планирования, но полностью не исчезает.

Главный вызов ближайших лет — найти баланс между эффективностью автоматизации и этическими требованиями справедливости. Компании, которые решат эту задачу первыми, получат долгосрочное конкурентное преимущество в новой эпохе цифровой рекламы, где алгоритмы будут не только эффективными, но и справедливыми.